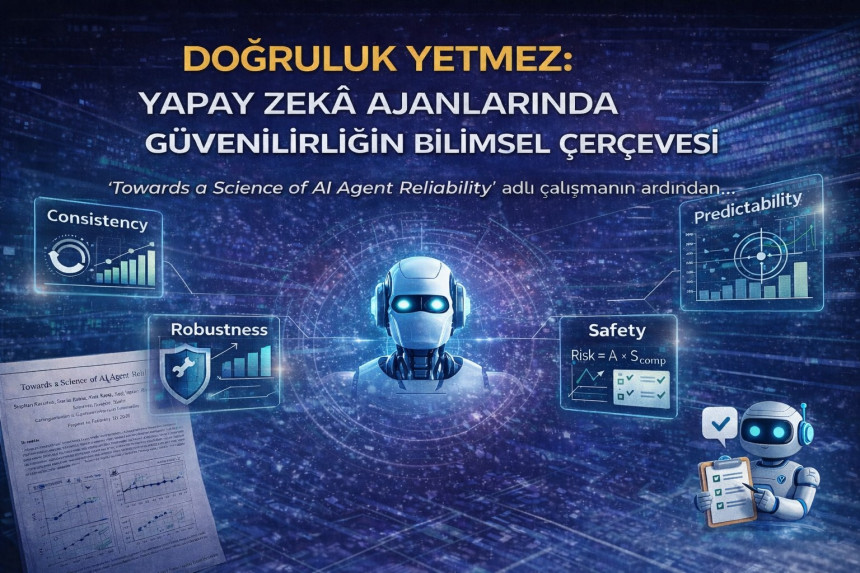

Doğruluk Yetmez: Yapay Zekâ Ajanlarında Güvenilirliğin Bilimsel Çerçevesi

Yıllardır yapay zekâ performansını accuracy üzerinden konuşuyoruz. Yüzde kaç doğru yaptı? Hangi benchmark’ta kaç puan aldı?

Bu çalışma, bu yaklaşımın eksik olduğunu savunuyor.

Araştırmacılar açık bir iddiayla yola çıkıyor:

Güvenilirlik, doğruluktan farklı ve çok boyutlu bir kavramdır.

Ve bunu sistematik olarak ölçmeye çalışıyorlar.

Yazarlar, LLM tabanlı ajanları dört ana boyutta değerlendiriyor:

- Consistency (Tutarlılık)

- Predictability (Öngörülebilirlik)

- Robustness (Dayanıklılık)

- Safety (Güvenlik)

Bu ayrımın önemi şu:

Bu boyutlar birbirinden bağımsız ilerleyebiliyor.

Bir modelin accuracy’si artarken:

- Tutarlılığı artmayabilir

- Öngörülebilirliği düşebilir

- Güvenlik riski değişmeyebilir

Bu, özellikle üretim ortamlarında kritik.

Çalışmanın sonuçları, frontier modellerde genel performans artışı olduğunu gösteriyor. Ancak tutarlılık metriklerinde anlamlı ve istikrarlı bir iyileşme görülmüyor.

Bu ne demek?

Model bir görevi bir koşulda çözüyor, küçük değişiklikte farklı bir davranış gösterebiliyor.

Kurumsal kullanımda bu şu anlama gelir:

- Otomasyon akışları kırılgan olabilir

- Tekrarlanabilirlik garanti değildir

- Süreç güvenilirliği yalnızca ortalama başarıya bağlı değildir

2️⃣ Öngörülebilirlik: Model Kendi Başarısızlığını Tahmin Edebiliyor mu?

Predictability iki alt bileşene ayrılıyor:

▪ CalibrationModel, genel başarı oranını doğru tahmin ediyor mu?

Yeni nesil modellerde calibration belirgin biçimde iyileşmiş. Yani modeller ortalama performanslarını daha gerçekçi tahmin edebiliyor.

▪ DiscriminationModel, hangi görevde başarısız olacağını ayırt edebiliyor mu?

Burada tablo daha karmaşık. Özellikle GAIA benchmark’ında discrimination gelişimi sınırlı hatta bazı durumlarda gerileyen bir görünüm sergiliyor.

Bu ayrım çok önemli:

Bir model ortalama başarısını doğru tahmin edebilir ama spesifik bir görevde başarısız olacağını öngöremeyebilir.

Gerçek dünyada risk tam burada oluşur.

Çalışmanın en dikkat çekici bölümlerinden biri “abstention” analizi.

Model:

- Yapamayacağı bir görevi bırakabiliyor mu?

- Yoksa özgüvenle yanlış mı yapıyor?

Araştırmacılar, özellikle “proceeded but failed” kategorisini kritik bir risk alanı olarak tanımlıyor.

Bu kategori şunu temsil ediyor:

Model görevi üstleniyor ama başarısız oluyor.

Regülasyonlu sektörlerde bu durum ciddi operasyonel risk üretir.

Bir modelin hata yapması sorun değildir.

Hata yapacağını bilmemesi sorundur.

4️⃣ Robustness: Küçük Değişim, Büyük Etki mi?

Robustness üç alt başlıkta incelenmiş:

- Tool ve API hatalarına dayanıklılık

- Ortam değişikliklerine dayanıklılık

- Prompt yeniden ifade edildiğinde stabilite

Tool hataları ve timeout’lara karşı dayanıklılık yüksek seviyede. Ancak prompt robustness hâlâ değişken.

Özellikle açık uçlu görevlerde küçük bir ifade değişikliği büyük performans farkı yaratabiliyor.

Bu bulgu, kontrollü kurumsal sistemler ile açık web ortamları arasındaki güvenilirlik farkını da açıklıyor.

Çalışma güvenliği iki bileşene ayırıyor:

- İhlal olmayan görev oranı

- İhlal olduğunda şiddet

Ve riski şu şekilde formüle ediyor:

Risk = (İhlal olasılığı) × (İhlal şiddeti)

Bu yaklaşım önemli çünkü güvenliği tek bir “kaç hata yaptı” metriğine indirgemiyor.

Az ama ağır hata ile çok ama hafif hata aynı kategoriye konulmuyor.

Bu, güvenlik değerlendirmesinde daha mühendislik temelli bir yaklaşım sunuyor.

Araştırmacılar ayrıca τ-bench benchmark’ındaki yapısal sorunlara da dikkat çekiyor. Görevlerin önemli bir bölümünde:

- Hatalı ground truth

- Çelişkili cevap anahtarı

- Belirsiz görev tanımı

tespit edilmiş.

Bu bölüm özellikle değerli çünkü çalışma yalnızca modelleri değil, ölçüm araçlarını da eleştiriyor.

AI güvenilirliği tartışılırken değerlendirme altyapısının kalitesi de kritik bir faktör.

Bu çalışma üç nedenle önemli:

- Güvenilirliği tek boyutlu bir performans metriğinden çıkarıyor.

- Ölçülebilir ve ayrıştırılmış bir çerçeve öneriyor.

- “Daha zeki model = daha güvenilir model” varsayımını sorguluyor.

AI sistemleri artık yalnızca daha doğru olmak zorunda değil.

Daha tutarlı, daha öngörülebilir ve daha güvenli olmak zorunda.

Araştırmacı Perspektifi

Bu çalışmayı okurken şu çıkarımı yapıyorum:

Önümüzdeki dönemde yapay zekâ rekabeti yalnızca model büyüklüğü veya benchmark skorları üzerinden şekillenmeyecek.

Asıl fark yaratacak alan:

- Kalibrasyon mühendisliği

- Abstention stratejileri

- Görev bazlı risk modellemesi

- Benchmark tasarımının bilimselleştirilmesi

Yani performans yarışı, güvenilirlik yarışına evriliyor.

“Towards a Science of AI Agent Reliability”, yapay zekâ değerlendirme literatüründe önemli bir dönüm noktası.

Bu çalışma bize şunu hatırlatıyor:

Zekâ ile güvenilirlik aynı şey değildir.

Ve belki de önümüzdeki on yılın asıl sorusu şu olacak:

Daha akıllı sistemler mi inşa edeceğiz,

yoksa daha güvenilir olanları mı?

Gerçek ilerleme, bu ikisini birleştirebildiğimiz noktada başlayacak.